Choisir le bon nom de domaine

27 octobre 2015

RÉVOLUTION : LES PSEUDOS ENFIN AUTORISÉS SUR FACEBOOK

21 décembre 2015Deux systèmes nouvellement développés pour les voitures sans conducteur peut identifier l’emplacement et l’orientation d’un utilisateur dans les lieux où le GPS ne fonctionne pas, et d’identifier les différents composants d’une scène de route en temps réel sur un appareil photo classique ou d’un smartphone, d’effectuer le même travail que les capteurs coûtant des dizaines des milliers de livres.

Les systèmes distincts mais complémentaires ont été conçues par des chercheurs de l’Université de Cambridge et démonstrations sont disponibles gratuitement en ligne. Bien que les systèmes ne peuvent pas contrôler actuellement une voiture sans conducteur, la capacité de faire une machine «voir» et identifier avec précision où il est et ce qu’il regarde est un élément vital de développer des véhicules autonomes et de la robotique.

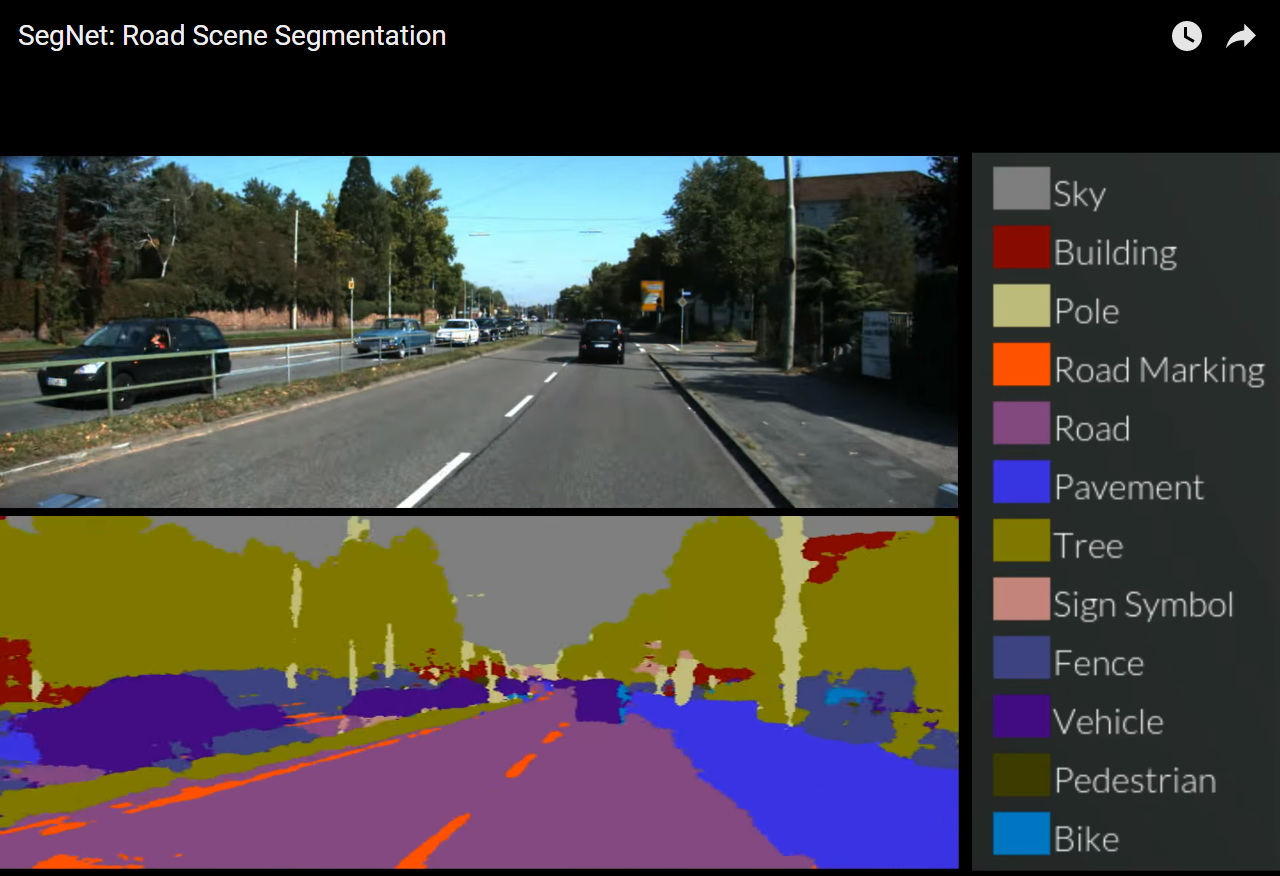

Le premier système, appelé SegNet, peut prendre une image d’une scène de rue, il n’a pas vu avant et classer, trier des objets en 12 catégories, telles les différentes routes, panneaux de signalisation, les piétons, les bâtiments et les cyclistes – en temps réel. Il peut faire face à des environnements de lumière, d’ombre et de nuit, et des étiquettes actuellement plus de 90% de pixels correctement. Les systèmes précédents utilisant des capteurs coûteux laser ou radar ont pas été en mesure d’atteindre ce niveau de précision tout en fonctionnant en temps réel.

Les utilisateurs peuvent visiter le site Web SegNet et télécharger une image ou rechercher toute cité ou ville dans le monde, et le système d’étiqueter toutes les composantes de la scène de route. Le système a été testé avec succès sur les deux routes de la ville et les autoroutes.

Pour les voitures sans conducteur en cours de développement, et de la base radar capteurs sont chers – en fait, ils coûtent souvent plus cher que la voiture elle-même. En contraste avec capteurs coûteux, qui reconnaissent les objets à travers un mélange de pluie et LIDAR (une technologie de télédétection), SegNet apprend par l’exemple, il a été «formé» par un groupe industrieuse des étudiants de premier cycle de Cambridge, qui a qualifié manuellement chaque pixel dans chacune des 5000 images, avec chaque image prenant environ 30 minutes à remplir. Une fois que l’étiquetage a été terminé, les chercheurs ont ensuite pris deux jours pour «former» le système avant qu’il ne soit mis en action.

« Il est remarquable à reconnaître les choses dans une image, car il a eu tellement pratique », a déclaré Alex Kendall, un étudiant au doctorat au Département de génie. « Cependant, il ya un million de boutons que nous pouvons nous tourner pour peaufiner le système pour qu’il garde de mieux en mieux. »

SegNet a été principalement formés à l’autoroute et en milieu urbain, il a donc encore beaucoup à apprendre à faire pour, enneigées ou désertiques rurales environnements-même si elle a bien fonctionné dans les tests initiaux pour ces environnements.

Le système n’a pas encore atteint le point où il peut être utilisé pour contrôler une voiture ou un camion, mais il pourrait être utilisé comme un système d’avertissement, semblable aux technologies anti-collision est actuellement disponible sur certains véhicules de tourisme.

« Vision est nos voitures les plus puissantes de sens et sans conducteur seront également besoin de voir, » a déclaré le professeur Roberto Cipolla, qui a dirigé la recherche. « Mais enseigner une machine pour voir est beaucoup plus difficile qu’il n’y paraît. »

Comme les enfants, nous apprenons à reconnaître les objets par exemple, si on nous montre une voiture jouet à plusieurs reprises, nous apprennent à reconnaître à la fois que la voiture particulière et d’autres voitures similaires pour le même type d’objet. Mais avec une machine, il est pas aussi simple que montrer une seule voiture et d’avoir ensuite il être capable de reconnaître tous les différents types de voitures. Machines aujourd’hui apprennent sous surveillance: parfois par des milliers d’exemples étiquetés.

Il ya trois questions clés technologiques qui doivent être répondues à concevoir des véhicules autonomes: où suis-je, ce qui est autour de moi et ce que je fais maintenant. SegNet aborde la deuxième question, tout un système distinct mais complémentaire répond à la première en utilisant les images pour déterminer à la fois l’emplacement et l’orientation précise.

Le système de localisation conçu par Kendall et Cipolla fonctionne sur une architecture similaire à SegNet, et est capable de localiser un utilisateur et de déterminer leur orientation à partir d’une seule image de la couleur dans une scène urbaine occupé. Le système est beaucoup plus précis que le GPS et travaille dans des endroits où le GPS n’a pas, comme à l’intérieur, dans les tunnels, ou dans les villes où un signal GPS fiable est pas disponible.

Il a été testé sur un tronçon de un kilomètre de long du roi de Parade dans le centre de Cambridge, et il est en mesure de déterminer à la fois l’emplacement et l’orientation à quelques mètres et quelques degrés, ce qui est beaucoup plus précis que le GPS-une considération essentielle pour les voitures sans conducteur . Les utilisateurs peuvent essayer le système pour eux-mêmes ici.

Le système de localisation utilise la géométrie d’une scène d’apprendre son emplacement précis, et est en mesure de déterminer, par exemple, si elle est à la recherche à l’est ou à l’ouest d’un bâtiment, même si les deux côtés semblent identiques.

« Le travail dans le domaine de l’intelligence artificielle et la robotique a réellement pris son envol au cours des dernières années», a déclaré Kendall. « Mais ce qui est cool à propos de notre groupe est que nous avons développé une technologie qui utilise l’apprentissage en profondeur pour déterminer où vous êtes et ce qui vous entoure – ceci est la première fois que cela a été fait en utilisant l’apprentissage en profondeur. »

« A court terme, nous sommes plus susceptibles de voir ce genre de système sur un robot domestique – comme un robot aspirateur, par exemple», a déclaré Cipolla. « Il faudra du temps avant que les conducteurs peuvent faire entièrement confiance à une voiture autonome, mais le plus efficace et précis, nous pouvons faire de ces technologies, plus nous sommes à l’adoption généralisée de voitures sans conducteur et d’autres types de robotique autonome. »